Revista T3/Imagens Falsas

Pesquisadores acadêmicos criaram uma nova exploração de trabalho que assume os alto-falantes inteligentes do Amazon Echo e os força a destrancar portas, fazer ligações e compras não autorizadas e controlar fornos, micro-ondas e outros dispositivos inteligentes.

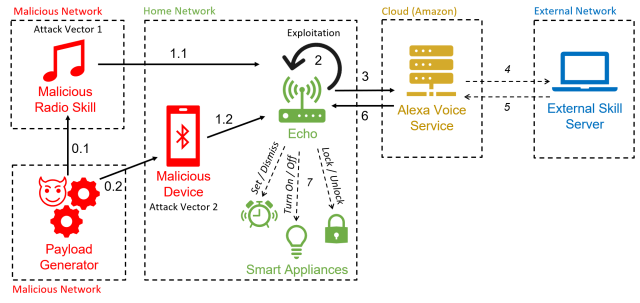

O ataque funciona usando o alto-falante do dispositivo para emitir comandos de voz. Desde que a fala contenha a palavra de ativação do dispositivo (geralmente “Alexa” ou “Echo”) seguida de um comando permitido, o Echo o executará, descobriram pesquisadores da Royal Holloway University, em Londres, e da Universidade de Catania, na Itália. . Mesmo quando os dispositivos exigem confirmação verbal antes de executar comandos sensíveis, é trivial contornar a medida adicionando a palavra “sim” cerca de seis segundos após a emissão do comando. Os invasores também podem explorar o que os pesquisadores chamam de “FVV”, ou vulnerabilidade total de voz, que permite que o Echos execute comandos auto-emitidos sem reduzir temporariamente o volume do dispositivo.

Alexa, vá se hackear

Como o hack usa a funcionalidade Alexa para forçar os dispositivos a executar comandos auto-emitidos, os pesquisadores o apelidaram de “AvA”, abreviação de Alexa vs. Alexa. Alexa. Ele requer apenas alguns segundos de proximidade com um dispositivo vulnerável enquanto ligado para que um invasor fale um comando de voz informando-o para se conectar ao dispositivo habilitado para Bluetooth de um invasor. Enquanto o dispositivo permanecer dentro do alcance de rádio do Echo, o invasor poderá emitir comandos.

O ataque “é o primeiro a explorar a vulnerabilidade de comandos arbitrários auto-emitidos em dispositivos Echo, permitindo que um invasor os controle por um longo período de tempo”, escreveram os pesquisadores em um artigo. papel Postado há duas semanas. “Com este trabalho, eliminamos a necessidade de ter um alto-falante externo próximo ao dispositivo alvo, o que aumenta a probabilidade geral de um ataque.”

Uma variação do ataque usa uma estação de rádio maliciosa para gerar os comandos auto-emitidos. Esse ataque não é mais possível na forma mostrada no documento após os patches de segurança que a Amazon, fabricante do Echo, divulgou em resposta à investigação. Os pesquisadores confirmaram que os ataques funcionam contra dispositivos Echo Dot de terceira e quarta geração.

Esposito et al.

O AvA começa quando um dispositivo Echo vulnerável se conecta via Bluetooth ao dispositivo do invasor (e para Echos não corrigidos, quando eles reproduzem a estação de rádio maliciosa). Depois disso, o invasor pode usar um aplicativo de conversão de texto em fala ou outros meios para transmitir comandos de voz. Aqui está um vídeo do AvA em ação. Todas as variações do ataque ainda são viáveis, com exceção do que é mostrado entre 1:40 e 2:14:

Alexa vs. Alexa – Demonstração.

Os pesquisadores descobriram que poderiam usar o AvA para forçar os dispositivos a executar uma série de comandos, muitos deles com sérias consequências de privacidade ou segurança. Possíveis ações maliciosas incluem:

- Controle outros eletrodomésticos inteligentes, como desligar as luzes, ligar um micro-ondas inteligente, definir o calor para uma temperatura insegura ou desbloquear fechaduras inteligentes. Como observado acima, quando o Echos requer confirmação, o adversário só precisa adicionar um “sim” ao comando cerca de seis segundos após a solicitação.

- Ligue para qualquer número de telefone, incluindo um controlado pelo invasor, para que os sons próximos possam ser ouvidos. Enquanto os Echos usam uma luz para indicar que estão fazendo uma chamada, os dispositivos nem sempre são visíveis para os usuários, e usuários menos experientes podem não saber o que a luz significa.

- Faça compras não autorizadas usando a conta Amazon da vítima. Embora a Amazon envie um e-mail notificando a vítima da compra, o e-mail pode ser perdido ou o usuário pode perder a confiança na Amazon. Como alternativa, os invasores também podem remover itens que já estão no carrinho de compras da conta.

- Manipule o calendário vinculado anteriormente de um usuário para adicionar, mover, excluir ou modificar eventos.

- Personifique habilidades ou inicie qualquer habilidade de escolha do atacante. Isso, por sua vez, pode permitir que invasores obtenham senhas e dados pessoais.

- Recupere todas as declarações feitas pela vítima. Usando o que os pesquisadores chamam de “ataque de mascaramento”, um adversário pode interceptar comandos e armazená-los em um banco de dados. Isso pode permitir que o adversário minere dados privados, colete informações sobre as habilidades usadas e infira os hábitos do usuário.

Os pesquisadores escreveram:

Com esses testes, mostramos que o AvA pode ser usado para dar comandos arbitrários de qualquer tipo e duração, com ótimos resultados; em particular, um invasor pode controlar luzes inteligentes com uma taxa de sucesso de 93%, comprar itens indesejados com sucesso na Amazon 100% do tempo e manipular [with] um cronograma vinculado com uma taxa de sucesso de 88%. Comandos complexos que devem ser totalmente reconhecidos corretamente para serem bem-sucedidos, como ligar para um número de telefone, têm uma taxa de sucesso quase ideal, neste caso 73%. Além disso, os resultados mostrados na Tabela 7 demonstram que o invasor pode configurar com sucesso um ataque de mascaramento de voz por meio de nossa capacidade de ataque de máscara sem ser detectado, e todas as instruções emitidas podem ser recuperadas e armazenadas no banco de dados. .