Aurich Lawson/Getty Images

A multiplicação de matrizes é no coração de muitos avanços de aprendizado de máquina, e se tornou duas vezes mais rápido. Na semana passada, DeepMind Anunciado descobriu uma maneira mais eficiente de realizar a multiplicação de matrizes, quebrando um recorde de 50 anos. Esta semana, dois pesquisadores austríacos da Universidade Johannes Kepler de Linz alegar eles superaram esse novo recorde em um passo.

Multiplicação de matrizes, que isso implica a multiplicação de duas matrizes retangulares de números geralmente está no centro do reconhecimento de fala, reconhecimento de imagem, processamento de imagem de smartphone, compactação e geração de gráficos de computador. As unidades de processamento gráfico (GPUs) são particularmente boas para realizar a multiplicação de matrizes devido à sua natureza massivamente paralela. Eles podem dividir um grande problema matemático de matriz em muitas partes e atacar partes dele simultaneamente com um algoritmo especial.

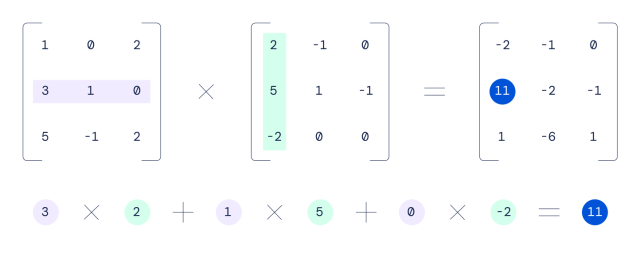

Em 1969, um matemático alemão chamado Volker Strassen descoberto o melhor algoritmo acima para multiplicar matrizes 4 × 4, o que reduz o número de etapas necessárias para realizar um cálculo de matriz. Por exemplo, multiplicar duas matrizes 4 × 4 usando um método escolar tradicional exigiria 64 multiplicações, enquanto o algoritmo de Strassen pode realizar a mesma façanha em 49 multiplicações.

mente profunda

Usando uma rede neural chamada AlphaTensor, a DeepMind descobriu uma maneira de reduzir essa contagem para 47 multiplicações, e seus pesquisadores publicou um artigo sobre a conquista na Nature na semana passada.

Passar de 49 etapas para 47 não parece muito, mas quando você considera quantos trilhões de cálculos de matriz são executados em uma GPU todos os dias, até melhorias incrementais podem se traduzir em grandes ganhos de eficiência, permitindo que aplicativos de IA sejam executados mais rapidamente. os que existem. hardware.

Quando a matemática é apenas um jogo, a IA vence

AlphaTensor é descendente de AlphaGo (que derrotado campeão mundial Vamos jogadores em 2017) e oleiro, que abordava xadrez e shogi. A DeepMind chama o AlphaTensor de “o primeiro sistema de IA a descobrir algoritmos novos, eficientes e comprovadamente corretos para tarefas fundamentais como multiplicação de matrizes”.

Para descobrir algoritmos matemáticos de matriz mais eficientes, o DeepMind configurou o problema como um jogo para um jogador. A empresa eu escrevi sobre o processo em mais detalhes em uma postagem do blog na semana passada:

Neste jogo, o tabuleiro é um tensor tridimensional (matriz de números), que capta o quão longe de correto está o algoritmo atual. Através de um conjunto de movimentos permitidos, correspondentes às instruções do algoritmo, o jogador tenta modificar o tensor e zerar suas entradas. Quando o jogador consegue fazer isso, isso resulta em um algoritmo de multiplicação de matriz comprovadamente correto para qualquer par de matrizes, e sua eficiência é capturada pelo número de passos dados para zerar o tensor.

A DeepMind então treinou o AlphaTensor usando aprendizado por reforço para jogar este jogo de matemática fictício, semelhante ao modo como o AlphaGo aprendeu a jogar. Vamos— e melhorou gradualmente ao longo do tempo. Eventualmente, ele redescobriu o trabalho de Strassen e outros matemáticos humanos, então os superou, de acordo com a DeepMind.

Em um exemplo mais complicado, o AlphaTensor descobriu uma nova maneira de realizar a multiplicação de matrizes 5×5 em 96 etapas (acima de 98 no método anterior). Esta semana, Manuel Kauers e Jakob Moosbauer de Johannes Universidade Kepler em Linz, Áustria, publicou um artigo alegando que eles reduziram essa conta em um, até 95 multiplicações. Não é coincidência que esse novo algoritmo aparentemente recorde surgiu tão rapidamente porque foi baseado no trabalho do DeepMind. Em seu artigo, Kauers e Moosbauer escrevem: “Esta solução foi obtida a partir do esquema de [DeepMind’s researchers] aplicando uma sequência de transformações que levam a um esquema do qual uma multiplicação pode ser eliminada”.

O progresso tecnológico se desdobra e, com a IA agora procurando novos algoritmos, outros registros matemáticos de longa data podem cair em breve. Semelhante à forma como o design assistido por computador (CANALHA) permitiu o desenvolvimento de computadores mais complexos e mais rápidos, a IA pode ajudar os engenheiros humanos a acelerar sua própria implantação.