Ars Technica

Para não ficar de fora da pressa de integrar IA generativa à pesquisa, na quarta-feira o DuckDuckGo anunciou DuckAssist, um serviço de resumo factual alimentado por IA, desenvolvido com tecnologia da Anthropic e da OpenAI. Ele está disponível gratuitamente hoje como um extenso teste beta para usuários de extensões de navegador DuckDuckGo e aplicativos de navegação. Sendo impulsionada por um modelo de IA, a empresa admite que o DuckAssist pode inventar coisas, mas espera que isso aconteça raramente.

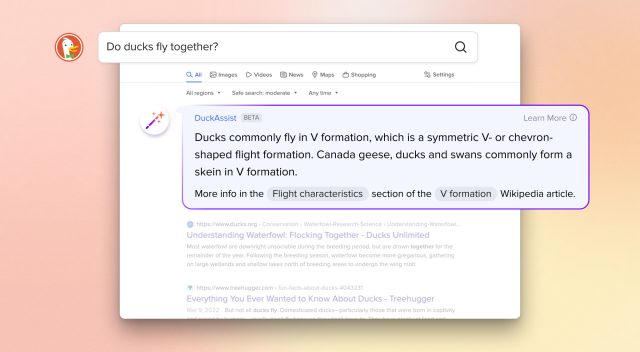

Así es como funciona: si un usuario de DuckDuckGo busca una pregunta que puede ser respondida por Wikipedia, DuckAssist puede aparecer y usar la tecnología de lenguaje natural de IA para generar un breve resumen de lo que encuentra en Wikipedia, con los enlaces de origen enumerados a seguir. O resumo aparece acima dos resultados de pesquisa normais do DuckDuckGo em uma caixa especial.

A empresa posiciona o DuckAssist como uma nova forma de “resposta instantânea”, um recurso que evita que os usuários vasculhem os resultados da pesquisa na web para encontrar informações rápidas sobre tópicos como notícias, mapas e clima. Em vez disso, o mecanismo de pesquisa apresenta os resultados da Resposta instantânea acima da lista usual de sites.

pato pato para ganhar

O DuckDuckGo não diz qual modelo de linguagem grande (LLM) ou modelos ele usa para gerar o DuckAssist, embora alguma forma de API OpenAI pareça provável. A Ars Technica entrou em contato com os representantes da DuckDuckGo para esclarecimentos. Mas o CEO da DuckDuckGo, Gabriel Weinberg, explica como ele usa o sourcing em um postagem no blog da empresa:

O DuckAssist responde a perguntas examinando um conjunto específico de fontes (por enquanto, geralmente a Wikipedia e, às vezes, sites relacionados como Britannica) usando a indexação ativa do DuckDuckGo. Como usamos a tecnologia de linguagem natural da OpenAI e da Anthropic para resumir o que encontramos na Wikipedia, essas respostas devem responder mais diretamente à sua pergunta real do que os resultados de pesquisa tradicionais ou outras respostas instantâneas.

Como o principal ponto de venda do DuckDuckGo é a privacidade, a empresa diz que o DuckAssist é “anônimo” e enfatiza que não compartilha navegação ou histórico de navegação com ninguém. “Também mantemos seu histórico de navegação e pesquisa anônimo para nossos parceiros de conteúdo de pesquisa”, escreve Weinberg, “neste caso, OpenAI e Anthropic, usados para resumir as frases da Wikipedia que identificamos”.

Se o DuckDuckGo estiver usando a API GPT-3 ou ChatGPT da OpenAI, pode-se temer que o site envie a consulta de cada usuário para a OpenAI sempre que for invocada. Mas, lendo nas entrelinhas, parece que apenas o artigo da Wikipedia (ou um extrato de um) é enviado ao OpenAI para resumo, não a pesquisa do usuário em si. Também entramos em contato com o DuckDuckGo para esclarecimentos sobre esse ponto.

O DuckDuckGo chama o DuckAssist de “o primeiro de uma série de recursos generativos assistidos por IA que esperamos lançar nos próximos meses”. Se o lançamento correr bem e ninguém o interromper com avisos conflitantes, o DuckDuckGo planeja lançar o recurso para todos os usuários de pesquisa “nas próximas semanas”.

DuckDuckGo: risco de alucinações “diminuiu bastante”

Como abordamos anteriormente no Ars, os LLMs tendem a produzir resultados errôneos convincentes, que os pesquisadores de IA chamam de “alucinações” como um termo artístico no campo da IA. As alucinações podem ser difíceis de detectar, a menos que você conheça o material que está sendo referenciado, e elas ocorrem em parte porque os LLMs estilo GPT da OpenAI não distinguem entre fato e ficção em seus conjuntos de dados. Além disso, os modelos podem fazer inferências falsas com base em dados precisos.

Neste ponto, DuckDuckGo espera evitar alucinações confiando fortemente na Wikipedia como fonte: “pedindo ao DuckAssist para apenas resumir informações da Wikipedia e fontes relacionadas”, Weinberg escreve“a probabilidade de ele “alucinar”, ou seja, inventar alguma coisa, é consideravelmente reduzida.”

Embora confiar em uma fonte de informação de qualidade possa reduzir erros de desinformação no conjunto de dados de IA, pode não reduzir inferências falsas. E o DuckDuckGo coloca o ônus da verificação dos fatos no usuário, fornecendo um link de origem abaixo do resultado gerado pela IA que pode ser usado para examinar sua precisão. Mas não será perfeito, e o CEO Weinberg admite: “No entanto, o DuckAssist não gerará respostas precisas todas as vezes. Esperamos que ele cometa erros”.

À medida que mais empresas implementam a tecnologia LLM que pode facilmente desinformar, pode levar algum tempo e o uso generalizado antes que empresas e clientes decidam qual nível de alucinação é tolerável em um produto com IA projetado para informar as pessoas objetivamente.